Battimenti, Psicoacustica,

Ingegneria del Suono e deciBel

Ingegneria del Suono e deciBel

Brani testuali by Corso Audio Multimediale di Marco Sacco e Wikipedia

Testi ed immagini selezionati e supervisionati da Alan Perz

L’orecchio umano

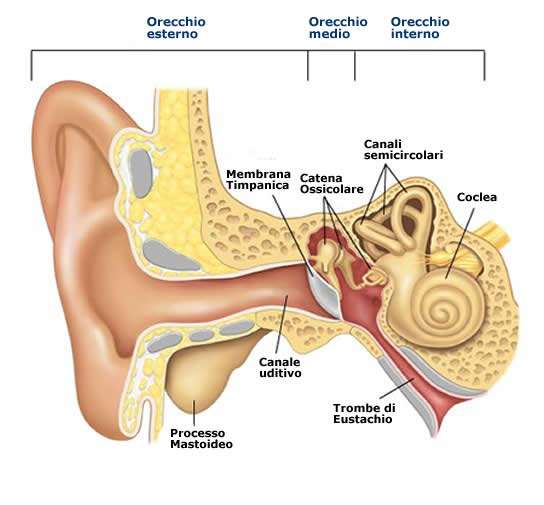

L’orecchio umano agisce da trasduttore nel trasformare energia acustica, prima in energia meccanica e successivamente in energia elettrica. Una volta che l’energia è stata convertita dalla forma meccanica a quella elettrica dall’orecchio, gli impulsi elettrici arrivano al cervello attraverso delle terminazioni nervose. Qui vengono elaborati permettendo la percezione del suono e, dulcis in fundo, l’ascolto della musica. L’apparato uditivo è composto da tre sezioni: l’orecchio esterno, l’orecchio medio e l’orecchio interno.

L’analisi del funzionamento di queste tre sezioni ci permetterà di capire il meccanismo di percezione del suono e saremo in grado di individuare quali parametri modificare sul suono che stiamo trattando per ottenere il risultato che vogliamo. A questo proposito consideriamo la situazione seguente.

Supponiamo di eseguire un missaggio in cui è presente un flautino che ogni tanto fa capolino tra gli altri strumenti. Se vogliamo che sia una presenza eterea, avvolgente, indefinita, possiamo intervenire sul suono tagliandone le alte frequenze. Vedremo tra un momento che uno dei fattori più rilevanti per individuare la direzione di un suono è il suo contenuto di alte frequenze. Tradotto significa che riusciamo più facilmente ad individuare la direzione di un suono con un elevato contenuto di alte frequenze rispetto ad uno contenente solo basse frequenze. Dunque, se vogliamo che il flautino sia ben presente anche se lontano per esempio sulla destra del nostro mix, metteremo il pan-pot a destra e accentueremo le alte frequenze (facendo naturalmente attenzione a non snaturare la natura del suono…).

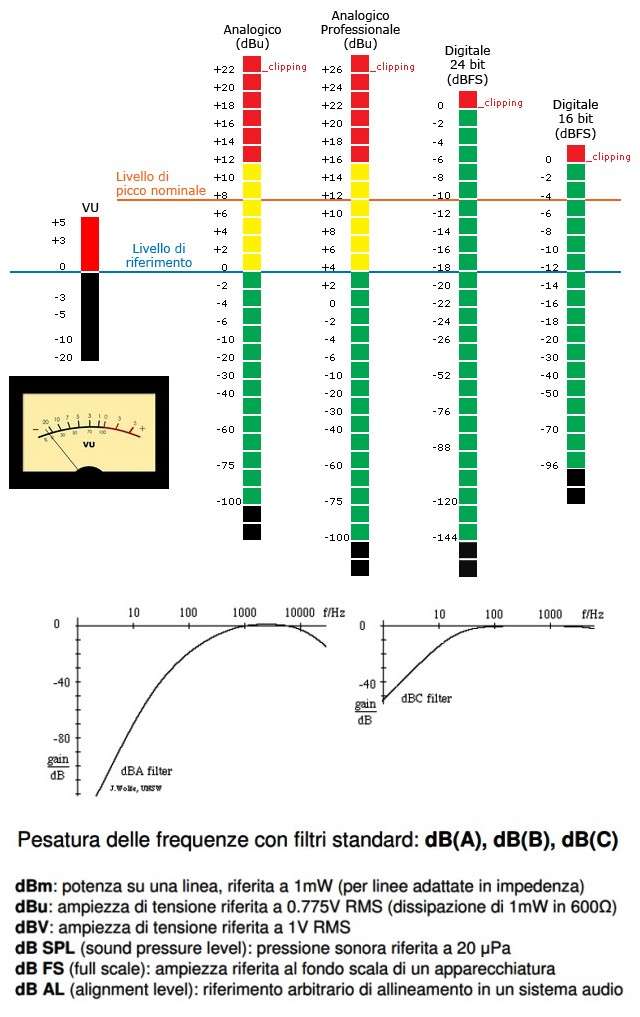

Figura 1 – L’orecchio umano

Orecchio esterno

Il primo organo che il suono incontra quando raggiunge l’orecchio è il padiglione auricolare. Questo offre una vasta superficie al fronte sonoro e permette di raccogliere un’ampia porzione del fronte d’onda. Per ottenere una superficie più ampia si portando le mani alle orecchie come viene istintivo fare quando si ascolta un suono molto debole. Il suono viene riflesso dal padiglione auricolare e concentrato verso il condotto uditivo la cui lunghezza è mediamente pari a 3 cm.

Questo significa che quando un gruppo di frequenze di valore intorno a 3KHz arrivano all’orecchio, il canale uditivo entra in risonanza e dunque quelle frequenze subiscono una naturale amplificazione. Vedremo in quanti casi viene sfruttata questa grandezza in campo audio e allora sarete contenti di aver superato anche questo ostacolo per arrivare alla conoscenza di questo piccolo ma fondamentale valore.

Orecchio medio

Il condotto uditivo termina su una membrana, il timpano, che vibra in accordo con il suono che ha raggiunto l’orecchio. Alla parte opposta del timpano sono collegati tre ossicini chiamati: martello, incudine e staffa. Questi hanno la funzione di amplificare la vibrazione del timpano e ritrasmetterla alla coclea, un ulteriore osso la cui funzione verrà spiegata tra un momento. Questa amplificazione si rende necessaria in quanto mentre il timpano è una membrana molto leggera sospesa in aria, la coclea è riempita con un fluido denso e dunque molto più difficile da mettere in vibrazione. I tre ossicini sono tenuti insieme da una serie di piccoli legamenti che hanno l’ulteriore funzione di impedire che seguano una vibrazione molto ampia con il rischio di rimanere danneggiati nel caso in cui l’orecchio venga sottoposto ad una pressione sonora troppo elevata. Un’apertura all’interno dell’orecchio medio porta alla cosiddetta tuba di Eustachio che consiste di un canale che conduce verso la cavità orale. La sua funzione è quella di dare uno sfogo verso l’esterno in modo da equilibrare la pressione atmosferica ai due lati del timpano (ecco perché sott’acqua è possibile compensare la pressione esterna, che aumenta con la profondità, aumentando la pressione interna tappando il naso e soffiandoci dentro).

Orecchio interno

Questa sezione dell’orecchio effettua la conversione dell’energia meccanica in impulsi elettrici da inviare al cervello per l’elaborazione del suono. L’ultimo dei tre ossicini di cui sopra, la staffa, è in contatto con la coclea attraverso una membrana che viene chiamata finestra ovale. La coclea è un osso a forma di chiocciola contenente del fluido (è dotata di tre piccoli canali circolari orientati secondo le tre direzioni dello spazio che vengono utilizzati dal cervello per la percezione dell’equilibrio). Il fluido riceve la vibrazione dalla staffa attraverso la finestra ovale e la trasporta al suo interno dove è presente il vero organo deputato alla conversione dell’energia meccanica in energia elettrica: l’organo del Corti. All’interno dell’organo del Corti troviamo la membrana basilare che ospita una popolazione di ciglia, circa 4000, che vibrano in accordo con la vibrazione del fluido. Ogni gruppo di ciglia è collegato ad una terminazione nervosa in grado di convertire la vibrazione ricevuta dal fluido in impulsi elettrici da inviare al cervello per essere elaborati e percepiti come suoni. Il motivo per cui l’orecchio umano percepisce le frequenze in modo logaritmico deriva dalla composizione della membrana basilare. I gruppi di ciglia, chiamati bande critiche, infatti sono ognuno sensibili ad una finestra di ampiezza 1/3 di ottava dello spettro di frequenza. In altre parole la membrana basilare è suddivisa in settori ognuno sensibile ad una determinata banda di frequenza ognuna di ampiezza pari a 1/3 di ottava e si comporta come un analizzatore di spettro. Ogni volta che il suono aumenta di un’ottava, viene eccitata una parte della membrana sempre equidistante dalla precedente riproducendo così un comportamento di tipo logaritmico.

Percezione del suono da parte del cervello

Senza entrare in discorsi filosofici che, per quanto interessanti non contribuirebbero a raggiungere le finalità di questo corso, diremo solo che la percezione di un suono, come quella della realtà del resto, è un concetto in gran parte soggettivo. Un suono in sé stesso è quello che è, ma la nostra percezione varia in quanto dipende da innumerevoli variabili. Alcune di queste variabili sono: la nostra posizione rispetto al suono, le condizioni del nostro apparato uditivo e soprattutto la forma che il cervello conferisce al suono. L’udito, al pari della vista che interpreta la luce, è capace di percepire solo una parte delle onde acustiche che ci circondano e dunque restituisce un quadro parziale. Inoltre le onde percepite vengono elaborate dal cervello che così ‘interpreta’ i suoni che deve elaborare. Nel seguito verrà descritto il comportamento del suono dal punto di vista della sua percezione e si mostrerà come in determinate condizioni sia evidente l’azione del cervello che interpreta la realtà sonora piuttosto che restituirla fedelmente. Un esempio molto eloquente in proposito viene descritto nel seguito e prende il nome di battimenti.

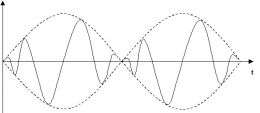

Grafico 1 – Forma d’onda di un battimento classico

Battimenti

Quando siamo in presenza di due suoni le cui frequenze differiscono di poco, percepiamo un ulteriore suono simile a un battito il cui ritmo è dato dalla differenza delle due frequenze originarie. Se queste frequenze sono troppo diverse tra di loro il cervello non è più in grado di percepire il suono differenza. Questo dipende dal fatto che le due frequenze, per essere percepite come battimento, debbono eccitare ciglia appartenenti alla stessa banda critica. La frequenza del battimento è pari al numero di volte che le due sinusoidi componenti vanno in fase e fuori fase in un secondo. Vediamo un esempio pratico. Consideriamo due sinusoidi pure di frequenza pari a 400 Hz e 405 Hz. Quando le due sinusoidi vengono sommate danno luogo ad una nuova forma d’onda che viene percepita come battimento.

Mascheramento

Una frequenza con ampiezza elevata può mascherare frequenze vicine con ampiezze inferiori in quanto frequenze vicine vengono decodificate da ciglia appartenenti alla stessa banda critica. Questa proprietà viene massicciamente sfruttata per realizzare algoritmi di compressione dei dati audio in formato digitale quali l’MP3 e l’ATRAC impiegato sui sistemi MiniDisc. Tali algoritmi consentono compressioni dell’ordine di 5:1.

Effetto Doppler

Questo fenomeno si verifica quando o la sorgente sonora o l’ascoltatore sono in movimento. Il classico esempio che viene sempre fatto è quello della sirena di un’ambulanza che arriva di gran carriera, ci supera e prosegue sfrecciando via nella notte.

Facciamo riferimento alla figura precedente in cui l’ambulanza è ferma e la sirena emette un suono che, essendo di una certa frequenza, genera dei fronti d’onda a distanza costante l’uno dall’altro. Quando invece il mezzo è in movimento e si avvicina all’ascoltatore, la stessa sirena genera un suono con dei fronti d’onda più ravvicinati rispetto a quando il mezzo era fermo perché muovendosi comprime i fronti d’onda. Dato che ora i fronti d’onda sono più ravvicinati percepiamo una frequenza più alta cioè un suono più acuto. Quando il mezzo ci supera (e sfreccia via nella notte), allontanandosi distanzia i fronti d’onda e dunque in questa fase percepiamo un suono più grave perché ci arriva una frequenza più bassa.

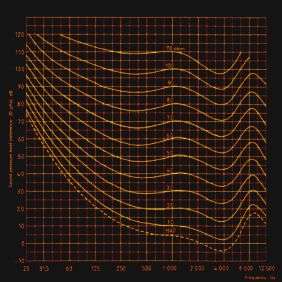

Curve isofoniche

Sono grafici molto importanti che permettono di avere un riferimento su come l’orecchio umano reagisca alle diverse frequenze. Sono state ricavate elaborando i dati su un campione statistico sottoposto ad una serie suoni prodotti in una camera anecoica. Tale camera viene disegnata con lo scopo di ridurre al minimo le riflessioni sulle pareti in modo che l’ascoltatore sia raggiunto unicamente dal segnale diretto. Le curve indicano come l’orecchio umano reagisca diversamente alle varie frequenze in termini di intensità sonora percepita. Supponiamo di avere una sorgente sonora in grado di generare onde sinusoidali con frequenza variabile e ampiezza costante. Fissando l’ampiezza per esempio a 80 dBspl noteremmo che un ascoltatore percepisce le basse frequenze come aventi un volume molto basso e man mano che frequenza viene aumentata avrebbe la percezione che anche il volume aumenta (mentre la pressione sonora realmente generata è sempre di 80 dBspl). Questo comportamento si spiega con il fatto che l’orecchio umano ha una percezione diversa dell’intensità sonora al variare della frequenza. Le curve isofoniche sono dette tali in quanto indicano il valore di dBspl necessario per percepire un suono sempre allo stesso volume lungo ogni curva. La frequenza di riferimento per ogni curva è 1KHz e a tale frequenza, il valore di dBspl è pari al valore che identifica una particolare curva e che prende il nome di phon. Per esempio la curva isofonica a 40 phon è quella che a 1 KHz ha un’ampiezza di 40 dBspl.

Grafico 2 – Curve isofoniche

Cominciamo a dare un’occhiata a questi grafici che sembrano un pò ostici e vediamo di capirci qualcosa:

Prendiamo una delle curve, per esempio quella a 80 phon e seguiamola dalle basse verso le alte frequenze. Vediamo che a 20 Hz è necessario produrre una pressione sonora di 118 dBspl e questo ci mostra come l’orecchio umano abbia una minore sensibilità alle basse frequenze. Scorrendo la curva verso le alte frequenze vediamo che affinchè l’orecchio percepisca sempre la stessa intensità sonora sono necessari livelli di pressione sonora più bassi. A 1KHz incontriamo il valore di riferimento della curva isofonica che stiamo considerando, dunque 80 dBspl. Oltre questo valore vediamo che la curva ha un minimo in corrispondenza dei 3KHz e vediamo come affinchè l’orecchio percepisca sempre la stessa pressione sonora, la frequenza di 3 KHz deve generare 70 dBspl. Confrontando questo valore con quello a 20 Hz notiamo una differenza di circa 50 dBspl in meno, è una differenza enorme. Questo valore di minimo dipende dal fatto che la frequenza di risonanza del canale uditivo è di circa 3 KHz e dunque tale frequenza viene percepita già a bassi valori di dBspl. Oltre i 3 KHz la curva risale mostrando il livello di dBspl necessario per avere la stessa percezione di volume alle alte frequenze. Le curve vengono mostrate per diversi valori di phon in quanto il comportamento dell’orecchio varia ai diversi valori della pressione sonora. Notiamo come per elevati valori della pressione sonora, l’andamento delle curve isofoniche è quasi piatto.

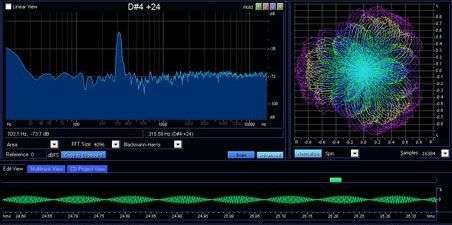

Figura 2 – Elaborazione del suono al computer

Suggerimento

Il controllo di loudness negli amplificatori da casa è regolato proprio dall’andamento di queste curve. Quando il volume è molto basso, l’inserimento del circuito di loudness avrà come effetto quello di aumentare le basse frequenze allineandone l’ampiezza con le altre. Per volumi elevati, questo allineamento avviene in modo naturale da parte dell’orecchio e dunque l’azionamento del loudenss a questi volumi avrà un effetto pressoché nullo.

Descrizione delle curve isofoniche

Soglia di udibilità (0 phons)

La curva isofonica più bassa di tutte viene denominata soglia di udibilità e indica la più piccola variazione di pressione che l’orecchio è in grado di individuare alle diverse frequenze. Ricordiamo che queste curve sono ottenute elaborando dati statistici e dunque che i valori che stiamo considerando possono avere differenze anche notevoli da individuo a individuo.

Soglia del dolore (120 phons)

Per pressioni sonore i cui valori si trovano al di sopra di questa curva l’orecchio comincia a percepire dolore fisico e per esposizioni prolungate si possono generare danni non reversibili.

Il volume ideale per eseguire un missaggio (mixdown) è intorno a 80-90 phons. A questi valori il bilanciamento dei volumi delle frequenze è abbastanza uniforme. Se il mixdown venisse eseguito a un volume troppo basso, per esempio a 40 phons, si avrebbe una minore percezione dei bassi e si potrebbe essere tentati ci compensare agendo sugli equalizzatori. Una volta però che il nostro mix fosse riascoltato al 80 phons risulterebbe inondato di bassi…

Psicoacustica

La psicoacustica studia i meccanismi di elaborazione del suono da parte del cervello. La conoscenza di questi meccanismi è fondamentale nella pratica sul suono poichè permette, effettuando le opportune manipolazioni, di ottenere effetti sonori molto sofisticati. Uno dei fattori più importanti nell’elaborazione del suono deriva dal fatto che il cervello si trova a elaborare due flussi di informazione contemporaneamente: quelli che provengono dall’orecchio destro e da quello sinistro. Sono le differenze, a volte anche minime, tra questi due segnali che determinano la nascita di una nuova informazione associata alla composizione delle due onde sonore. In questo caso parliamo di suono stereofonico. Quando invece i due segnali che arrivano alle orecchie sono esattamente uguali parliamo di suono monofonico.

Figura 3 – Distanza dal segnale sorgente e fase

Differenze di tempo (fase)

Dalla figura precedente si vede come la distanza dalla sorgente onora delle due orecchie sia diversa e ciò si traduce in una differenza nel tempo di arrivo (denominato tempo di interarrivo) di ciascun segnale.

Naturalmente ciò implica una differenza di fase in quanto ritardo in tempo e differenza di fase sono intrinsecamente correlate.

Grafico 3 – Grafico di Binaural beat (20Hz) in modulazione di frequenza e differenza di fase (180°)

Differenze di ampiezza

Le ampiezze dei due segnali sono diverse sia perché l’ampiezza diminuisce all’aumentare della distanza sia perché il segnale che deve raggiungere l’orecchio più lontano deve aggirare l’ostacolo della testa e nel fare ciò perde energia. Inoltre le frequenze più alte non riusciranno proprio a superare l’ostacolo quindi i due segnali differiranno anche per il contenuto in frequenza. Questo è il motivo per cui risulta difficile individuare la direzione di provenienza delle basse frequenze: queste sono in grado di oltrepassare gli ostacoli senza una perdita di energia rilevante e dunque i suoni che arrivano alle due orecchie sono pressochè identici. Nel caso in cui la sorgente sonora sia esattamente dietro l’ascoltatore, la direzione viene individuata poichè viene riscontrata una mancanza delle alte frequenze che vengono bloccate dal padiglione auricolare.

Differenze nel contenuto armonico

Riferendoci alla figura precedente vediamo che una delle due onde deve “girare attorno” alla testa per raggiungere l’orecchio più lontano. Ciò comporta una leggera perdita sulle alte frequenze a causa della diffrazione.

Grafico 4 – Analisi in frequenza di Binaural beat – Battimento binaurale o biauricolare in differenza di frequenza

Stereofonìa

Uno dei fattori più importanti nella percezione del suono deriva dal fatto che il cervello si trova a elaborare due flussi di informazione contemporaneamente: quelli che provengono dall’orecchio destro e da quello sinistro. Sono le differenze, a volte anche minime, tra questi due segnali che determinano la nascita di una nuova informazione associata alla composizione delle due onde sonore. In questo caso parliamo di suono stereofonico . Quando invece i due segnali che arrivano alle orecchie sono esattamente uguali parliamo di suono monofonico.

La stereofonìa nasce nel momento in cui all’orecchio destro e quello sinistro arrivano due onde sonore diverse. La combinazione delle informazioni trasportate dalle due onde permette di percepire la spazialità di un suono: la sua distanza da noi e la sua posizione, l’ambiente in cui si propaga e il tipo di percorso che ha fatto. Se potessimo ascoltare solo con un orecchio, alcune di queste informazioni non sarebbero disponibili per l’elaborazione da parte del cervello e la percezione della spazialità di un suono sarebbe molto ridotta[9]. Dato che disponiamo di due orecchie, siamo abituati ad un ascolto naturalmente stereofonico. Ciò ci permette di individuare la direzione di provenienza di un suono e il tipo di ambiente in cui si è propagato [Vedi: Localizzazione di una sorgente sonora]. Il fatto di disporre di due orecchie ha portato l’industria audio a realizzare impianti di diffusione stereofonici, ossia con due diffusori che riproducono due segnali sonori distinti. I diffusori di un impianto stereofonico dovranno essere disposti rispetto all’ascoltatore sui vertici di un triangolo equilatero, dunque dovranno essere inclinati di 60° verso l’ascoltatore. Con questa disposizione, mandando ai diffusori lo stesso identico suono, questo ci apparirà come proveniente dal centro in quanto si genera un’immagine fantasma che il nostro cervello identificherà come proveniente dal centro.

Fusione binaurale

È quella facoltà del cervello per la quale due segnali simili che arrivano alle due orecchie vengono fusi in un unico segnale; il nuovo segnale è per così dire una creazione del cervello che non esiste nella realtà. Consideriamo per esempio uno xilofono. Eseguiamo una linea melodica e la registriamo su una traccia, successivamente eseguiamo la stessa linea con qualche leggera modifica e la registriamo su un’altra traccia. Facciamo suonare le due linee contemporaneamente mandando una linea sul canale sinistro e l’altra linea sul canale destro. Quello che ne esce è una terza linea melodica derivante dalla fusione delle due precedenti ma che nella realtà non esiste. Questo è uno dei segreti della magia della musica: i singoli strumenti eseguono delle linee melodiche e se facciamo attenzione riusciamo ad isolarle ed ad ascoltarle singolarmente, anche quando gli strumenti suonano tutti insieme. Ma quando lasciamo questa prospettiva e ci spostiamo su un piano più astratto, è in quel momento che riusciamo a percepire ciò che non esiste, la combinazione di tutti i suoni che creano un’armonia: è in quel momento che la musica nasce!

Effetto precedenza

L’effetto precedenza, o legge del primo fronte d’onda, è un effetto psicoacustico binaurale. Quando un suono è seguito da un altro suono separato da un ritardo temporale sufficientemente breve (sotto la soglia dell’eco dell’ascoltatore), gli ascoltatori percepiscono un singolo evento uditivo; la sua posizione spaziale percepita dipende essenzialmente dalla posizione del suono che giunge per primo (il primo fronte d’onda). Comunque, anche il suono in ritardo influisce sulla posizione percepita. Tuttavia, il suo effetto è nascosto dal primo suono in arrivo.

Una forma particolare dell’effetto precedenza è l’effetto Haas, il quale fu descritto nel 1949 da Helmut Haas nella sua tesi di dottorato.

La “legge del primo fronte d’onda” fu descritta e così denominata nel 1948 da Lothar Cremer.

L'”effetto precedenza” fu descritto e così denominato nel 1949 da Wallach et al. Essi mostrarono che, quando due suoni identici vengono presentati in rapida successione, questi vengono ascoltati come fusi in un unico suono. Nei loro esperimenti, la fusione si verificava quando il ritardo tra i due suoni era nell’intervallo compreso tra 1 e 5 ms per gli schiocchi (click) e fino a 40 ms per suoni più complessi come discorsi o musica per pianoforte. Quando il ritardo era maggiore, il secondo suono veniva ascoltato come un’eco.

In più, Wallach et al. dimostrarono che, quando i suoni successivi provenivano da sorgenti in posizioni diverse, venivano ascoltati come fusi; la posizione apparente del suono percepito dipendeva essenzialmente dalla posizione del suono che raggiungeva per primo le orecchie (cioè il primo fronte d’onda in arrivo). Il suono che giungeva per secondo aveva solo un effetto molto piccolo (anche se misurabile) sulla posizione percepita sul suono percepito come fuso. Essi indicarono questo fenomeno come effetto precedenza e osservarono che ciò spiega perché la localizzazione del suono sia possibile nella tipica situazione in cui i suoni riverberano da pareti, mobili e oggetti simili, fornendo dunque stimoli multipli e successivi. Essi osservarono anche che l’effetto precedenza rappresenta un fattore importante nella percezione dei suoni stereofonici.

Wallach et al. non variarono sistematicamente le intensità dei due suoni, anche se citarono la ricerca di Langmuir et al. la quale suggeriva che, se il suono che giunge per secondo è almeno 15 dB più rumoroso del primo, l’effetto precedenza scompare.

L'”effetto Haas” prende il nome da un articolo del 1951 di Helmut Haas. Nel 1951 Haas esaminò come la percezione di voci che parlano è influenzata in presenza di una singola riflessione sonora coerente. Per creare le condizioni anecoiche, l’esperimento venne condotto sul tetto di un edificio indipendente. Un altro test fu condotto in una camera con un tempo di riverbero di 1,6 ms. Il segnale di test (discorso registrato) venne emesso da due altoparlanti simili in posizioni a 45° a sinistra e a destra a 3 m di distanza dall’ascoltatore.

Haas trovò che gli esseri umani localizzano le sorgenti sonore nella direzione di arrivo del primo suono indipendentemente dalla presenza di una riflessione singola da una direzione diversa. Viene percepito un singolo evento uditivo. Una riflessione che giunge dopo più di 1 ms dal suono diretto aumenta il livello percepito e la spaziosità (più precisamente, la larghezza percepita della sorgente sonora). Una riflessione singola che giunge tra 5 e 30 ms dopo può essere fino a 10 dB più rumorosa rispetto al suono diretto senza essere percepita come un evento uditivo secondario (eco). Questo lasso di tempo varia con il livello della riflessione. Se il suono diretto sta provenendo dalla stessa direzione verso cui l’ascoltatore è rivolto, la direzione della riflessione non ha effetti significativi sui risultati. Una riflessione con le frequenze più alte attenuate espande l’intervallo di tempo in cui è attiva la soppressione dell’eco.[senza fonte] Anche l’aumento del tempo di riverbero della camera espande l’intervallo di tempo della soppressione dell’eco.

Effetto Haas

Prende il nome di effetto Haas un determinato fenomeno fisico che riguarda la percezione del suono da parte del cervello. Consideriamo il caso di un suono generato da una sorgente sonora, immaginiamo di essere in una stanza e di posizionarci ad una certa distanza dalla sorgente. A causa delle riflessioni del suono sulle pareti saremo raggiunti prima di tutto dal segnale proveniente direttamente dalla sorgente e in un secondo momento dalle riflessioni del segnale stesso sulle pareti della stanza. Questo ritardo è dovuto al fatto che il suono riflesso compie un percorso più lungo del segnale diretto. Se i due segnali arrivano con un piccolo ritardo l’uno dall’altro, viene percepito dal cervello un unico suono proveniente da una sola direzione. La direzione individuata dal cervello come quella di provenienza del suono è quella dell’onda che arriva per prima (questo vale anche se l’intensità della seconda onda è maggiore della prima) e per questo motivo questo effetto prende anche il nome di effetto di precedenza . Questo effetto si verifica quando il ritardo tra i due segnali è sufficientemente piccolo, più in particolare deve essere minore di 30-35ms. Questo intervallo temporale viene definito come zona di Haas . Si precisa che la zona di Haas varia fortemente con le caratteristiche del segnale percepito, in particolare per un segnale percussivo (colpo di rullante) la zona di Haas risulta più stretta rispetto al caso di un segnale con un inviluppo esteso (nota di violino).

Quando il ritardo fra i segnali esce dalla zona di Haas avvertiamo due segnali distinti ed entriamo nel caso dell’effetto eco per cui l’ascoltatore percepisce i due suoni separati. L’effetto Haas viene sfruttato nei sistemi di rinforzo sonoro sui segnali che vengono spediti alle torri di ritardo e nel mixing con l’obiettivo di allargare l’immagine stereofonica di un suono.

Ricostruzione della fondamentale

Abbiamo visto come l’esecuzione di una nota provochi l’eccitazione della frequenza fondamentale e di tutte le armoniche essendo queste le frequenze multiple della fondamentale. Il cervello è in grado di ricostruire, anche se con un certo errore, la fondamentale a partire dalle armoniche superiori. Per contestualizzare questa proprietà pensiamo ad una radiolina da stadio con il suo piccolo, rigidissimo altoparlante che suona la canzone dell’estate. Questa viene riprodotta con una banda di frequenze ridottissima ma è comunque individuabile la linea di basso grazie alla capacità del cervello di ricostruire la fondamentale a partire da informazioni sulle armoniche.

Effetto Cocktail Party

Descrive la capacità del cervello di reperire un segnale all’interno di un gruppo di segnali sonori sovrapposti. Pensate ad esempio ad una sala di ristorante in cui si può sentire un brusio generalizzato ma anche concentrarsi su una singola conversazione.

Testi (C) by Marco Sacco audiosonica.com e Wikipedia – Grafici e immagini (C) Amadeux

Intensità oggettiva

I valori di intensità di un suono vengono percepiti dal corpo umano su scala logaritmica. Per questo si è pensato di utilizzare un scala di misura logaritmica di tali valori. Infatti, il raddoppio di intensità sonora percepita corrisponderà ad una decuplicazione del valore iniziale. Cioè, se facciamo in modo che un diffusore emetta un suono ad una unità di pressione, per avere la sensazione del raddoppio, dovremo moltiplicare per dieci il valore di pressione iniziale, ottenendo come risultato 10. Quindi diviene conveniente utilizzare l’unità di misura, detta Bel, ottenibile dalla relazione:

Bel = log (W1/W2)

dove W è la potenza sonora. Nel campo dell’audio si usa una sottomultiplo di quest’unità di misura, ovvero il decibel, corrispondente ad un decimo di Bel, cosicché, alla formula precedente, debba essere aggiunto un fattore di moltiplicazione dieci. Nel caso in cui, invece, si vogliano confrontare valori di pressione, essendo la potenza proporzionale al quadrato della pressione la formula precedente diverrà:

Decibel = 20 log (P1/P2)

Per misurare una lunghezza abbiamo bisogno di un valore di riferimento, che nel sistema di riferimento internazionale è il metro. Allo stesso modo, per misurare un valore di intensità sonora dobbiamo fissare un valore di riferimento, che in questo caso corrisponde alla soglia di udibilità umana, ovvero 20 μP (0,00002 Pascal). Questo valore viene messo al denominatore dell’espressione precedente per calcolare l’intensità di qualsiasi suono. Altri valori importanti sono:

– Intensità acustica; W/m^2; corrisponde al flusso di potenza attraverso una superficie perpendicolare al moto vibratorio.

– Energia sonora; erg * cm^2/s; corrisponde all’energia sonora trasmessa nella unità di tempo attraverso la superficie unitaria.

– Pressione acustica; ∆p = p – p0; corrisponde alla variazione di pressione tra la pressione esercitata in un punto dal fenomeno vibratorio, e la pressione, esercitata nello stesso punto, in condizioni di assenza di perturbazione (ad esempio la pressione atmosferica).

Intensità soggettiva, Son

Il Son è l’unità di misura dell’intensità soggettiva, e viene definito come la sensazione data da un suono di 1000 Hertz a 40 Phon. Da qui notiamo che ogni 10 Phon ci sarà un raddoppio della percezione, e quindi del valore del son: questo vuol dire che la sensazione di raddoppio viene avvertita ad ogni aumento di circa 10 dB. Esiste, inoltre, una soglia differenziale per l’intensità, ovvero una minima variazione percepibile di tale valore. I dati variano dal 5% al 25%, o tra 2 e 3 dB; comunque tale caratteristica varia col variare della frequenza: l’incremento è massimo per i suoni gravi ed è minimo per quelli compresi tra 500 e 2000 Hertz.

Altezza oggettiva e soggettiva, Mel

L’altezza oggettiva è quella che misura i cicli al secondo di un suono, che esprime i propri valori in Hertz. Ma l’altezza percepita non sempre corrisponde a quella misurata. Per questo è stato introdotto il Mel; 1000 Mel corrispondono alla sensazione d’altezza provocata da un suono di 1000 Hertz a 40 dB. Di conseguenza 2000 Mel corrisponderanno ad un raddoppio della sensazione di frequenza e 500 Mel alla metà. Ma questi valori, misurati sperimentalmente, corrispondono, rispettivamente, a 3100 Hertz e 400 Hertz; ciò dimostra che l’altezza non è uguale alla frequenza. Anche per l’altezza esiste una soglia differenziale: per le frequenze comprese tra 500 e 2000 Hertz, i valori variano tra 2 e 10 cent, mentre per i suoni gravi si può arrivare anche a 50 cent.

Timbro

Il timbro è uno delle caratteristiche più complesse del suono, data la sua vasta possibilità di sfumature. Infatti ogni armonica ha una sua fluttuazione d’intensità, un suo inviluppo, che rendono in effetti ogni nota unica. Due note, suonate apparentemente allo stesso modo, presenteranno delle minuscole variazioni timbriche. Un’analisi del timbro può essere fatta attraverso la teoria formantica del timbro. Questa teoria volge la sua attenzione verso le zone dello spettro armonico, in cui si rileva un’emissione di maggiore intensità. Quindi si vengono ad individuare delle bande, più o meno larghe, dalla cui emissione, prevalentemente, dipende il timbro di un suono. Il timbro dipende anche dall’intensità di emissione di una nota e dall’altezza. Per l’intensità possiamo dire che al variare di essa, per via delle caratteristiche dello strumento e per la struttura dell’apparato uditivo, alcune zone di frequenze possono essere esaltate, mentre altre possono essere smorzate. Per l’altezza possiamo dire che, a causa della risposta in frequenza dell’orecchio e per alcune caratteristiche dello strumento, l’altezza può influire sul timbro, smorzando ad esempio gli armonici più alti (che cadrebbero verso i limiti del range frequenziale udibile).

Infine, possiamo dire che anche i transitori d’attacco e di estinzione influiscono sul timbro. Infatti, registrando suoni di strumenti e trattando il loro inviluppo lasciando invariato il timbro, essi potranno sembrare altri strumenti, anche con timbri differenti.

L’orecchio non è svincolato dalle leggi inerziali ed infatti necessita di un intervallo di tempo (detto tempo d’integrazione) per raggiungere il regime stazionario. Questo è un transitorio soggettivo, al di sotto del quale non è possibile distinguere né altezza, né intensità. Mediamente, per frequenze comprese tra 500 e 2500 Hertz, occorrono non meno di 8/10 di secondo, affinché il timbro sia percepito integralmente.

Guida alla Comprensione dei Decibel (dB)

Il decibel NON è un’unità di misura del volume

Non è un’unità di nulla. È un RAPPORTO, e compara il valore di un numero al valore di un altro.

E anche se questi numeri misurano solitamente il livello sonoro, non è sempre così. Nella musica, i decibel sono usati anche per misurare il voltaggio e la potenza della strumentazione.

Il decibel non è una misura LINEARE

La maggior parte della unità di misura sono LINEARI. Per esempio, 2 metri sono lunghi due volte 1 metro, e 4 metri sono lunghi due volte 2 metri. Traducendo questi numeri in un grafico, costituirebbero una retta.

Ma i decibel non funzionano così. I decibel sono delle unità di misura LOGARITMICHE. Se avete dimenticato ciò che sapevate sui logaritmi dalle superiori, eccovi un ripasso molto semplice:

Con i numeri logaritmici, ogni unità addizionale moltiplica il valore del numero esponenzialmente. Ad esempio:

+3dB = la potenza aumenta di 2 volte

+10dB = la potenza aumenta di 10 volte

+60dB = la potenza aumenta di 1,000,000 di volte

È chiaro? Bene. Ecco perché è necessario che abbiate ben compreso questo concetto:

La Relazione tra Decibel, Musica e Suono

In musica, i decibel sono una misura del Livello di Pressione Sonora (SPL). Se per esempio in un concerto rock le casse suonano a 110dB, ciò che si intende veramente è che stanno suonando a 110dB SPL.

Dato che i decibel sono solo una rapporto, i 110dB vanno letti in comparazione a un altro numero: 0 SPL.

0 SPL è il livello di pressione dell’aria standard dell’atmosfera (20 micropascal). È generalmente accettato come il limite più basso dell’udito umano, ed è il punto di riferimento per la comparazione dei suoni.

Ora… vedremo il lato pratico.

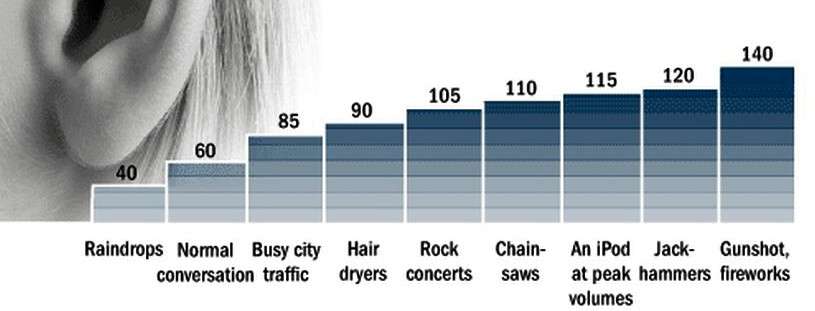

Livelli di Decibel: Utili Esempi nella Vita di Tutti i Giorni

Il modo migliore per familiarizzare con i decibel è attraverso la misurazione dei rumori nella vita reale. Ecco alcuni esempi di rumori con i quali conviviamo tutti i giorni:

Respiro: 10 dB

Sussurro: 20 dB

Normale conversazione: 40 dB

Rumore di fondo in ristorante: 60 dB

Radio o TV: 70 dB

Tritarifiuti: 80 dB

Martello pneumatico: 100 dB

Soglia del dolore (da rumore): 130 dB

Motore Jet: 150 dB

Bene. Andiamo avanti.

Come i Decibel Alterano il Volume Percepito

Per comprendere appieno il concetto di decibel, è necessario perlomeno intuire come un determinato cambiamento di decibel si traduca in una percepibile variazione di volume.

Onestamente… i calcoli da fare qui sono da far girare la testa. Perciò eccovi alcune semplici regole generali utili come scorciatoie:

+10dB = 2x il volume

+20dB = 4x il volume

+40dB = 16x il volume

Avviso: Anche se questi numeri sono utili, non sono “perfetti”. Un singolo livello di decibel può essere ascoltato in realtà a diversi livelli di volume sonoro.

Ecco come:

Come il Bilanciamento delle Frequenze Influenza il Volume

Se prendiamo come riferimento un valore di 60dB SPL, vi verrà naturale immaginarlo collegato a uno SPECIFICO livello di volume.

In realtà non è così. Il livello di volume percepito dal nostro cervello dipende anche dalle frequenze contenute dal suono.

A uguali livelli di decibel, le frequenze medie (comprese tra 1kHz e 4kHz) sono percepite come “più forti” rispetto alle frequenze alte e basse.

Questo fenomeno può essere approfondito con l’analisi della Curva di Fletcher e Munson.

Punto successivo:

Influenza della Distanza sul Volume Sonoro

Questo è sapere comune… più ci si allontana dalla sorgente sonora, più il suono perde forza.

Meno ovvia è la domanda “quanto?”. Anche qui, i calcoli sarebbero piuttosto complicati.

Eccovi due regole generali per semplificare:

2X la distanza = -6dB

10X la distanza = -20dB

Ora che avete una comprensione intuitiva di come i decibel misurino il livello del suono, c’è solo un’altra cosa che dovete sapere:

In Che Modo i Decibel Sono Utilizzati nell’Equipaggiamento per Registrare

Lo strumento più comune con il quale avrete a che fare con i decibel in uno studio di registrazione è il fonometro…

Presente in parecchi device all’interno di uno studio, come DAW, interfaccia audio, e altri.

Al limite massimo del fonometro, noterete la dicitura 0 dBFS (acronimo per “0dB full scale”). Questo è il livello di segnale più alto possibile che lo strumento può sopportare prima del clipping o della distorsione.

Sotto questo valore vedrete dei valori negativi in crescita di dBFS, fino a -8 dBFS.

A seconda di chi vi darà il consiglio, alcuni vi diranno di scegliere un valore compreso tra -15dB e -6dB quando impostate i valori di input per una registrazione. Io considero -10dB un buon compromesso.

Pesatura delle frequenze, misurazioni e deciBel